Wie können Unternehmen ihr Wissen so zugänglich machen, dass man effizient darauf zugreifen und es unkompliziert nutzen kann? Diese Frage ist für Unternehmen von zeitloser Bedeutung, insbesondere dann, wenn mit wachsender Größe auch die Komplexität und Vielfalt des Firmenwissens zunimmt. Künstliche Intelligenz (KI) hat sich seit dem Aufkommen von ChatGPT als leistungsstarkes Werkzeug etabliert, um schnell und gezielt auf Informationen zuzugreifen.

Doch Werkzeuge wie ChatGPT oder Gemini haben grundsätzlich keinen Zugang zu dem Wissen, das ein Unternehmen besonders macht – den wertvollen Informationen, die in Unternehmensrichtlinien, internen Wikis oder anderen Dokumenten verborgen liegen. Genau hier setzt dieser Beitrag an: Mithilfe der intelligenten Verknüpfung von firmeneigenen Wissensquellen und KI wird nicht nur die Zugänglichkeit verbessert, sondern auch der Nutzen und die Relevanz des Wissensmanagements im Unternehmen nachhaltig gesteigert.

Retrieval-Augmented Generation (RAG) hat sich in den letzten beiden Jahren als Schlüsseltechnologie etabliert, um KI mit einer spezifischen Wissensbasis zu verbinden. Dieser Ansatz ermöglicht es, präzise Antworten auf Basis von firmenspezifischen Quellen wie bspw. Confluence oder Dateiarchiven mit PDFs zu generieren. In diesem Beitrag werden die Grundprinzipien von RAG erläutert, die Vorteile im Vergleich zu öffentlichen KI-Chatbots aufgezeigt und ein konkretes Beispiel von IT Sonix vorgestellt: Ein interner Chatbot, der Informationen aus Confluence nutzt.

Gibt es dafür nicht ChatGPT?

KI-Systeme wie ChatGPT oder Gemini basieren auf öffentlich verfügbaren Daten und beeindrucken durch ihre Fähigkeit, breitgefächertes Wissen einfach und schnell bereitzustellen. Doch wenn es um spezifische, unternehmensinterne Fragestellungen geht, stoßen diese Systeme naturgemäß an ihre Grenzen. Sie kennen weder die individuellen Prozesse noch die spezifischen Herausforderungen eines Unternehmens, da diese Daten in der Regel nicht Teil ihrer Trainingsdaten sind. Im spezifischen unternehmerischen Kontext bieten solche Systeme daher nur eingeschränkten Mehrwert, da die benötigten Informationen von den Nutzenden selbst recherchiert und bereitgestellt werden müssen. Selbst wenn KI-Modelle mit spezifischen Informationen trainiert wurden, unterliegen unternehmensinterne Prozesse und Daten einem ständigen Wandel. Das Nachtrainieren solcher Modelle ist technisch anspruchsvoll, ressourcenintensiv und für öffentliche KI-Modelle oftmals gar nicht möglich.

Zusätzlich muss man sich die Frage stellen, welche Informationen überhaupt mit einem öffentlichen Anbieter von KI-Systemen geteilt werden sollten. Wenn die Daten das Unternehmen nicht verlassen sollen, dann müsste man das LLM (z.B. durch Nutzung eines Open-Source Modells) selbst betreiben.

Eine KI, die nahtlos auf firmenspezifische Wissensquellen zugreifen kann, hat das Potenzial, den Umgang mit Informationen im Unternehmen grundlegend zu verändern. Sie liefert präzise und kontextbezogene Antworten, die auf die spezifischen Anforderungen des Unternehmens zugeschnitten sind. Mitarbeitende profitieren von einer einfachen Verfügbarkeit von Wissen, indem sie in natürlicher Sprache danach fragen können. Das beschleunigt Prozesse, steigert die Produktivität und erhöht gleichzeitig den Wert des Wissensmanagements. Erst durch die effiziente Nutzung interner Datenquellen wird eine nachhaltige Pflege der Wissensbasis attraktiv. Diese Vorteile machen eine KI mit Domainwissen zu einem essenziellen Werkzeug für die Zukunft.

Retrieval-Augmented Generation (RAG)

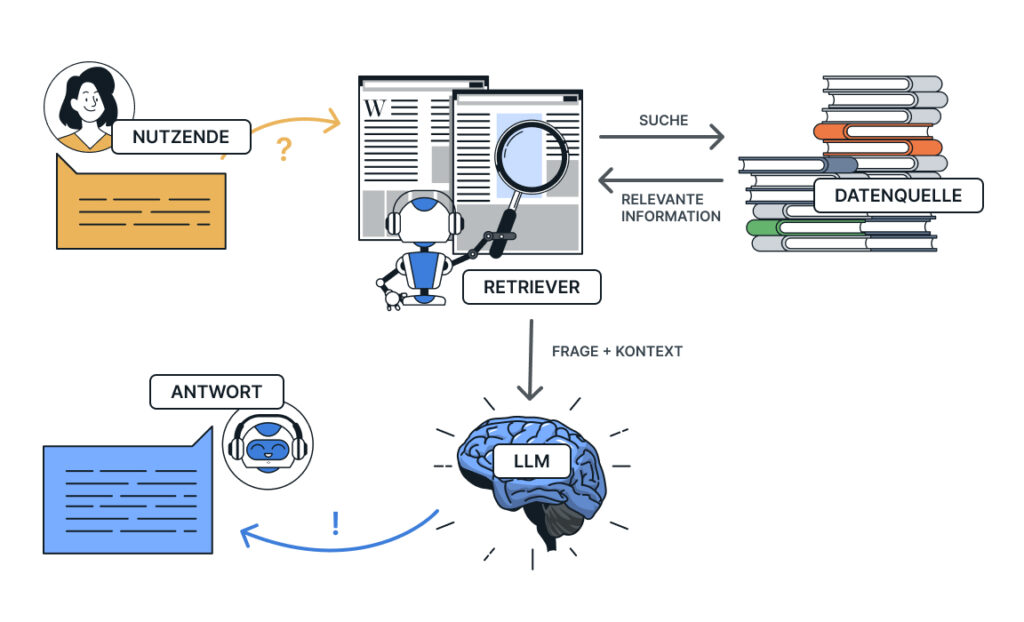

Retrieval-Augmented Generation (RAG) ist eine Methode, die das schnelle Auffinden relevanter Informationen (Information Retrieval) aus Datenquellen mit der Textgenerierung generativer KI kombiniert. Dabei werden die gefundenen Informationen genutzt, um spezifische Antworten zu erstellen. Anstatt nur die Suchergebnisse aus den Wissensquellen zu präsentieren oder ausschließlich die Trainingsdaten der KI-Modelle zu nutzen, kombiniert RAG die Vorteile beider Ansätze, um kontextbezogene Antworten zu liefern.

Basierend auf einer Anfrage werden relevante Informationen aus den internen Datenquellen gesucht. Dazu werden die Informationen zunächst aus den Quellsystemen in eine Vektordatenbank übertragen. Dieser Prozess umfasst zwei zentrale Schritte: Zuerst werden die Informationen in kleinere Pakete zerlegt (Chunking), anschließend werden diese Pakete in Zahlenvektoren übersetzt (Embedding). Diese numerischen Repräsentationen ermöglichen es, effizient semantisch zur Anfrage passende Informationen zu finden.

Die gefundenen Informationen werden dann zusammen mit der ursprünglichen Anfrage an das „Gehirn“ des Systems, das Large Language Model (LLM), weitergeleitet. Anders als die Informationen aus Trainingsdaten, die strukturell im KI-Modell gespeichert sind, werden die Daten aus der Wissensbasis dynamisch als Teil der User-Anfrage verarbeitet. Im letzten Schritt kann die KI die Antwort auf dieser Basis generieren.

Die Vorteile von RAG ergeben sich unmittelbar:

• Präzision: Antworten basieren direkt auf domainspezifischen Quellen und sind dadurch höchst relevant.

• Aktualität: Informationen aus bestehenden Datenquellen können sofort genutzt werden, ohne dass Anpassungen im KI-Modell erforderlich sind.

• Flexibilität: Neue Datenquellen können nahtlos eingebunden werden, sodass dynamisch auf sich verändernde Anforderungen und Wissensbestände reagiert werden kann.

IT Sonix Chatbot

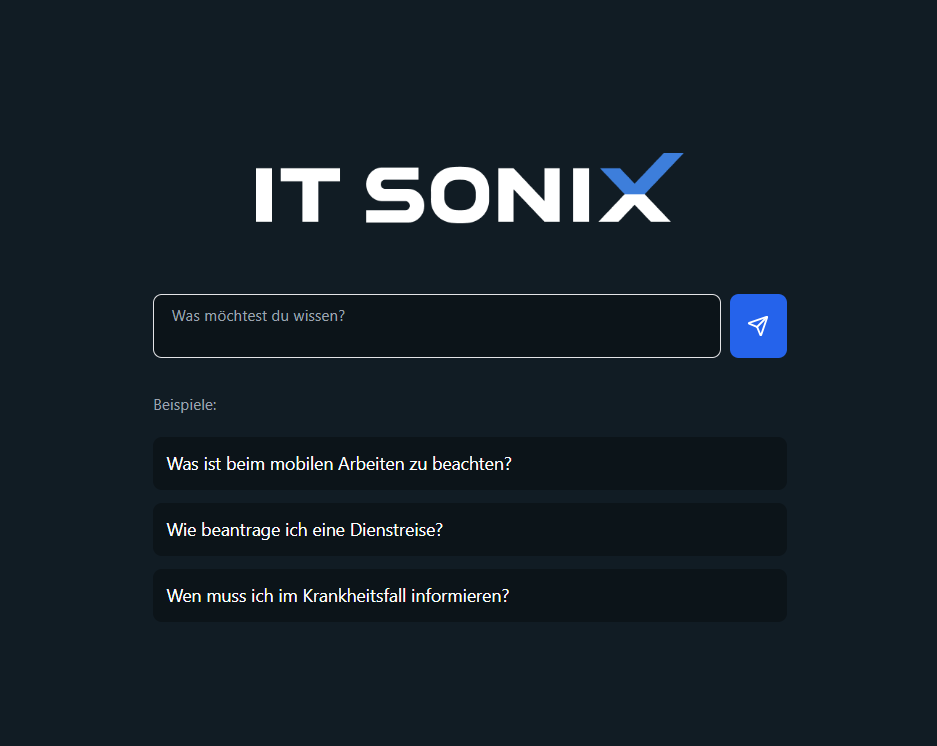

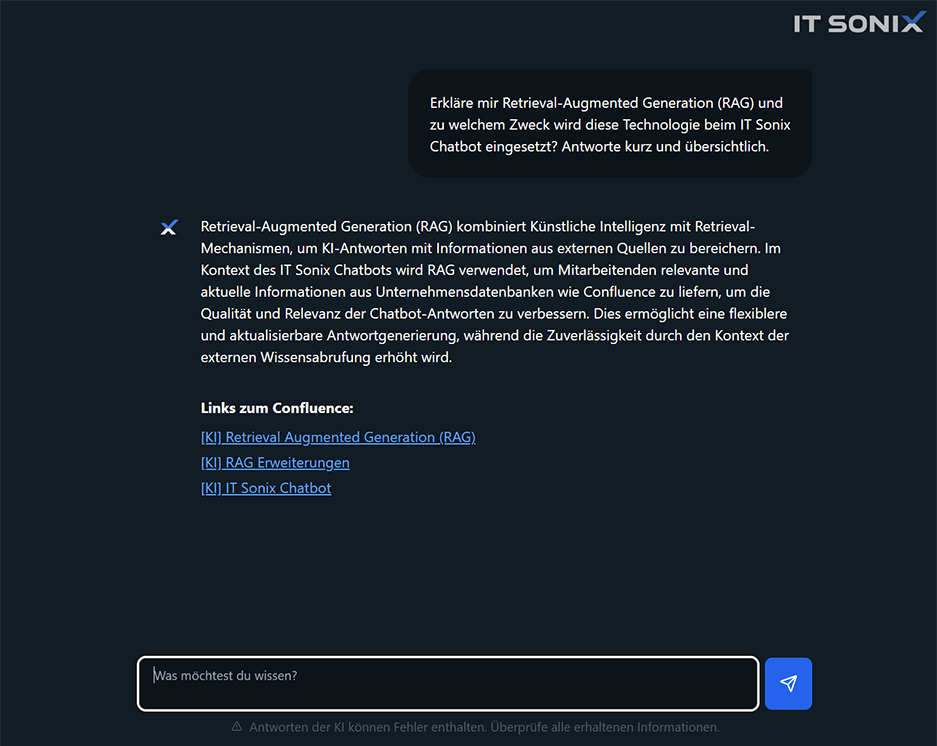

Um die Vorteile von RAG bei IT Sonix zu nutzen, wurde ein interner Chatbot entwickelt. Dieser greift auf Informationen aus dem internen Confluence-System zurück, um kontextbezogene Antworten zu generieren. Die Daten werden über die Confluence-API automatisiert abgerufen, mit Techniken wie Chunking und Embedding verarbeitet und in einer Vektordatenbank gespeichert. Dabei werden Metadaten wie Links zur ursprünglichen Confluence-Seite hinzugefügt, um die Quelle nachvollziehbar zu machen. Dies ermöglicht es, semantisch relevante Informationen schnell und präzise zu finden.

Beispiel IT Sonix Chatbot:

Bei einer Anfrage wird die Vektordatenbank nach passenden Informationen durchsucht, die als Grundlage für die Antwort dienen. Diese Antwort wird dann mithilfe einer Open-Source-KI generiert, die IT Sonix selbst hostet, sodass interne Informationen das Unternehmen nicht verlassen. Zusätzlich zur generierten Antwort stellt der Chatbot Links zu den relevanten Confluence-Seiten bereit, sodass Nutzende die Quellen direkt einsehen können. So macht der IT Sonix Chatbot Unternehmenswissen gezielt verfügbar, gewährleistet Nachvollziehbarkeit und teilt gleichzeitig keinerlei Daten mit externen Systemen.

Herausforderungen und Ausblick

Obwohl RAG eine vielversprechende Technologie ist, gibt es Herausforderungen, die adressiert werden müssen, um das volle Potenzial auszuschöpfen:

Sensitivität: Das Finden der passenden Informationen kann stark von der genauen Formulierung der User-Anfrage abhängen. Das kann dazu führen, dass der relevante Kontext nicht gefunden wird. Verbesserungen wie Reranking-Algorithmen, kontextbezogene Erweiterungen der einzelnen Pakete (Chunks) oder eine zusätzliche Verschlagwortung können helfen, dieses Problem zu lösen.

Sicherheitsaspekte: Es müssen Sicherheitsmechanismen für die Ausgaben der KI (Guardrails) und ein kluges Rechtemanagement etabliert werden, um firmengerechte Antworten sicherzustellen. Nutzende sollten nur auf Informationen zugreifen können, die für sie freigegeben sind. Das kann durch die Integration des Active Directory (AD) und entsprechende Metadaten für die Zugriffsrechte in der Wissensbasis umgesetzt werden. Gleichzeitig müssen Prozesse für schnelle Aktualisierungen vorhanden sein, bspw. wenn User-Zugriffe gesperrt oder geändert werden.

Stetige Weiterentwicklung: Die rasante Entwicklung im Bereich generativer KI und RAG bietet zahlreiche neue Möglichkeiten, erfordert jedoch auch kontinuierliche Evaluierung. Ansätze wie agentisches RAG, das Reflexion, Planung und den Einsatz zusätzlicher Tools wie Internetsuche oder das Erstellen von Visualisierungen und Grafiken integriert, erweitern die Funktionalität erheblich, müssen aber verstanden und sinnvoll eingesetzt werden.

Trotz dieser Herausforderungen zeigt sich, dass RAG eine zukunftsweisende Technologie ist, die mit den richtigen Optimierungen und Sicherheitsmaßnahmen einen enormen Mehrwert für Unternehmen bietet.